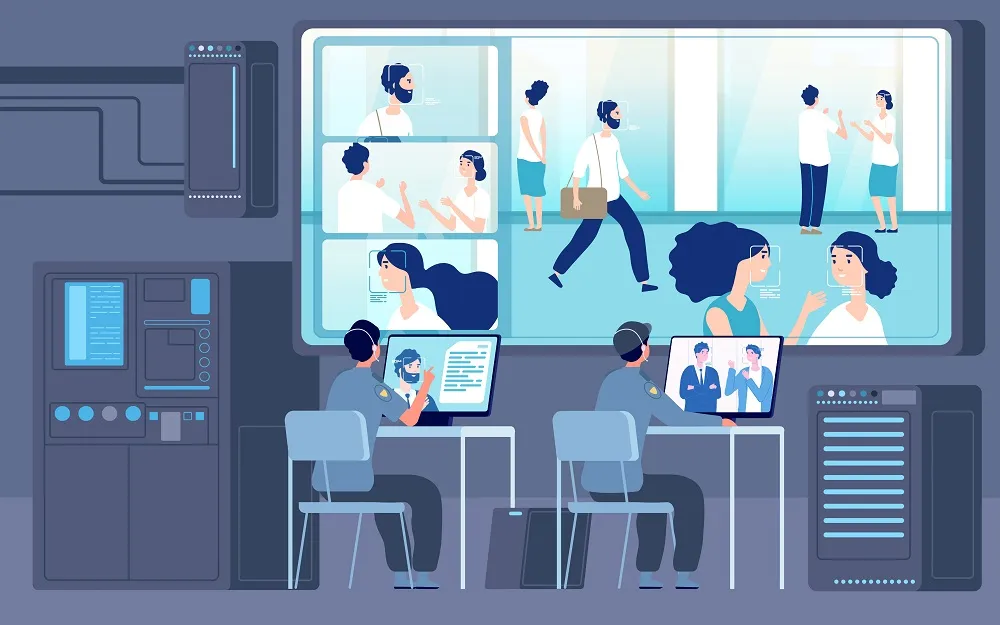

مع توسع مفهوم “المصانع الذكية” في إطار الثورة الصناعية الرابعة، أصبحت المراقبة الرقمية جزءاً أساسياً من عملية الإدارة والإنتاج. الكاميرات، وأجهزة الاستشعار، والأنظمة التحليلية القائمة على الذكاء الاصطناعي، تعمل اليوم على مراقبة كل تفصيل في خطوط الإنتاج، بدءاً من أداء الآلات وصولاً إلى سلوك العمال.

تُقدَّم هذه التقنيات بوصفها أدوات لتحسين الكفاءة وضمان السلامة، لكنها تفتح في الوقت ذاته باباً واسعاً أمام تساؤلات أخلاقية حول مدى مشروعيتها وحدود استخدامها. هل يحق للشركات جمع بيانات حسية وسلوكية عن موظفيها؟ وأين تنتهي الرقابة المبررة وتبدأ المراقبة المفرطة؟

البنية التقنية للمراقبة الصناعية

تعمل أنظمة المراقبة في المصانع الذكية وفق منظومة مترابطة تجمع بين أجهزة الاستشعار الفيزيائية، والكاميرات الذكية، وبرمجيات تحليل البيانات.

تشمل المكونات الأساسية:

- كاميرات عالية الدقة تتابع الحركات في خطوط الإنتاج، وتكشف السلوكيات “غير الآمنة” أو الانحرافات عن المسار المعتاد.

- أجهزة استشعار بيئية تقيس الحرارة والرطوبة ومستويات الضوضاء لتقييم ظروف العمل.

- أجهزة استشعار حركية تُثبت في المعدات أو حتى في ملابس العمال لتتبع النشاط والسرعة والإنتاجية.

- أنظمة تحليل بالذكاء الاصطناعي تدمج البيانات في لوحات تحكم رقمية تُستخدم لتقييم الأداء واتخاذ القرارات الإدارية.

هذه الأدوات لا تراقب الآلات فحسب، بل تجمع باستمرار بيانات بشرية ضمنياً، مثل معدل الحركة، فترات التوقف، أو حتى تعابير الوجه في بعض الأنظمة المتقدمة.

حدود الخصوصية في بيئة رقمية

في بيئة المصنع التقليدية، كانت الخصوصية محدودة بطبيعة المكان، لكن في المصنع الذكي تصبح كل لحظة موثقة رقمياً.

التحليل الآلي لا يميز بين ما هو إنتاجي وما هو شخصي، إذ تُسجل الأنظمة أنماط السلوك كافة دون تمييز.

تؤدي هذه الممارسات إلى تحول غير مسبوق في علاقة العامل بمكان العمل: فالعامل لم يعد يخضع فقط لإدارة بشرية، بل لإدارة خوارزمية ترصد وتقيّم وتصدر تنبيهات بشكل لحظي. هذا النوع من الرقابة المستمرة قد يخلق شعوراً بالضغط النفسي ويؤثر على الإبداع والمرونة في الأداء.

مبررات الشركات ودوافع المراقبة

من وجهة نظر الإدارة الصناعية، تُبرَّر المراقبة الرقمية باعتبارها أداة لتحسين السلامة وتقليل الأخطاء. فالكاميرات الذكية يمكنها رصد مخالفات السلامة أو الحوادث قبل وقوعها. كما تساعد بيانات الحركة في تحسين توزيع المهام وتقليل الهدر في الوقت والموارد.

إلى جانب ذلك، تلعب البيانات التحليلية دوراً في تطوير خوارزميات الصيانة التنبؤية، حيث تُستخدم المراقبة المستمرة لاكتشاف مؤشرات الأعطال في المعدات قبل حدوثها.

لكن هذا التوسع في جمع البيانات يجعل الفصل بين الرقابة التقنية والرقابة البشرية أمراً معقداً، خصوصاً حين تُستخدم المعلومات لتقييم الأداء الفردي أو فرض عقوبات إدارية.

الثغرات الأخلاقية والقانونية

تُظهر التجارب أن معظم أنظمة المراقبة الصناعية لا تخضع لمعايير واضحة تحدد نوع البيانات المسموح بجمعها أو مدة الاحتفاظ بها. في بعض الحالات، تُستخدم البيانات المسجلة لتقييم التزام العامل بالوقت أو مراقبة نشاطه خارج المهام المحددة، وهو ما يمثل انتهاكاً للخصوصية المهنية.

القوانين العمالية في عدد من الدول المتقدمة بدأت بالتعامل مع هذه القضية من زاوية “المراقبة المشروعة”. فمثلاً، تشترط اللائحة العامة لحماية البيانات الأوروبية (GDPR) أن تكون المراقبة ضرورية ومتناسبة مع الهدف منها، وأن تُبلغ بها الأطراف المعنية بشكل واضح.

في المقابل، تفتقر التشريعات في معظم الدول النامية إلى هذه الضوابط، ما يجعل العمال عرضة لجمع البيانات دون علمهم أو موافقتهم، تحت غطاء تحسين الإنتاج أو الأمان الصناعي.

الذكاء الاصطناعي كمدير خفي

في بعض المصانع، تُستخدم خوارزميات تحليل الصور والحركات لتقييم “كفاءة العامل” بناءً على سرعة الاستجابة وعدد الأخطاء ومعدل النشاط. هذه الأنظمة قد تصدر توصيات بتخفيض الأداء أو استبدال العامل استناداً إلى بيانات رقمية غير شفافة.

المشكلة أن الخوارزميات ليست محايدة دائماً، فهي تُبنى على مجموعات بيانات قد تتضمن تحيزات بشرية أو تفسيرات غير دقيقة للسلوك. بذلك تتحول أنظمة الذكاء الاصطناعي إلى سلطة تقييم لا يمكن مساءلتها بسهولة، ما يطرح إشكاليات أخلاقية تتعلق بالعدالة والمساءلة داخل بيئة العمل المؤتمتة.

الأثر النفسي والاجتماعي للمراقبة

المراقبة المستمرة تولد حالة من القلق المهني الدائم. حين يشعر العامل أنه مراقب في كل حركة، تتراجع مستويات الثقة داخل بيئة العمل. كما أن غياب الشفافية في كيفية تحليل البيانات يُضعف الإحساس بالعدالة التنظيمية ويزيد من الاحتكاك بين الإدارة والعاملين.

تُشير دراسات في علم النفس الصناعي إلى أن الإفراط في المراقبة يؤدي إلى انخفاض في الإبداع والمبادرة الذاتية، لأن العامل يركز على تجنب الأخطاء أكثر من تحسين الأداء. هذا التأثير النفسي يقلل من الميزة التنافسية التي يُفترض أن توفرها الأتمتة الذكية.

نحو توازن بين الكفاءة والخصوصية

تحقيق توازن عادل بين متطلبات الأمان والإنتاجية وحق العامل في الخصوصية يتطلب إطاراً متعدد المستويات:

- تحديد واضح لأهداف المراقبة، بحيث تقتصر على ما يخدم السلامة أو تحسين العمليات فقط.

- تشفير البيانات الشخصية وتقييد الوصول إليها بالمشرفين المصرح لهم.

- وضع سياسات شفافة تُبلغ العمال بطبيعة البيانات المجمعة وآلية استخدامها.

- إتاحة حق الاعتراض للعامل إذا شعر بأن المراقبة تتجاوز الغرض المعلن.

- تقييم دوري لأنظمة الذكاء الاصطناعي، للتأكد من خلوها من التحيز أو التفسير الخاطئ للسلوك البشري.

هذه الخطوات تعزز الثقة بين العمال والإدارة وتحول المراقبة من أداة للسيطرة إلى وسيلة لتحسين الأمان والاستدامة.

من المهم التذكّر

أن الأمان الصناعي لا يتحقق على حساب الكرامة الإنسانية. الخصوصية في بيئة العمل حق أساسي لا يُلغيه التطور التقني. يجب أن تُصمم المصانع الذكية وفق مبدأ “الرقابة الأخلاقية”، حيث تكون التكنولوجيا أداة دعم لا أداة مراقبة مطلقة.

إن التقدم الحقيقي في الصناعة لا يُقاس بعدد المستشعرات والكاميرات، بل بمدى احترام الإنسان في قلب بيئة العمل الذكية.