في النزاعات الحديثة، باتت الصور والفيديوهات ضرورية لإثبات الانتهاكات. تُستخدم هذه الأدلة أمام الإعلام والمحاكم الدولية، وغالبًا ما تمثّل الصوت الوحيد للضحايا. لكن ظهور تقنية التزييف العميق غيّر قواعد اللعبة. لم يعد كل ما نراه أو نسمعه قابلًا للتصديق دون تحقق دقيق.

تعتمد جهات متعددة على هذه التقنية لإنكار الجرائم أو خلق سرديات بديلة. لذلك، يحتاج العاملون في الإعلام وحقوق الإنسان إلى فهم عميق لهذه التقنية، وآثارها، وسبل التعامل معها.

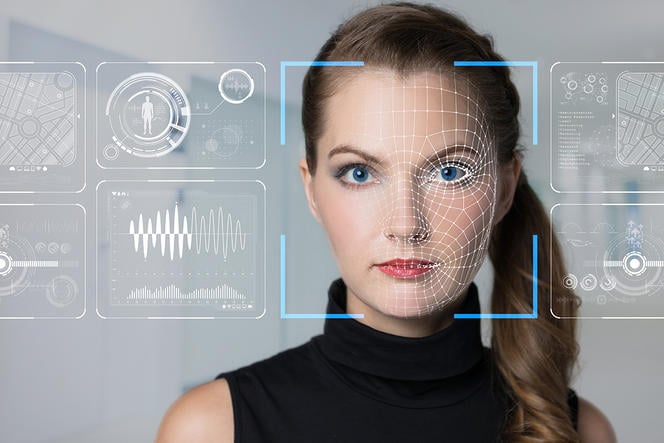

ما هو التزييف العميق؟ وكيف يعمل؟

تعتمد تقنية التزييف العميق (Deepfake) على خوارزميات الذكاء الاصطناعي. تقوم هذه الخوارزميات بتحليل بيانات حقيقية مثل ملامح الوجه ونبرة الصوت، ثم تعيد تركيبها داخل مقاطع مزيفة توهم المشاهد بأنها حقيقية.

بفضل توفر أدوات سهلة الوصول، أصبحت هذه التكنولوجيا متاحة لأي مستخدم، ما يزيد خطر استخدامها في التضليل داخل البيئات الهشة أمنيًا وإعلاميًا.

كيف تستغل الجهات الفاعلة هذه التقنية في النزاعات؟

1. إنكار الجرائم

ينتج الفاعلون مقاطع تُظهر مناطق القصف وكأنها لم تتعرض لأي ضرر. يعرضون هذه المقاطع لنفي مسؤوليتهم رغم وجود أدلة توثيقية من مصادر محايدة.

2. تشويه الشهادات

يعيدون إنتاج تسجيلات يظهر فيها الشاهد وكأنه يتراجع عن أقواله. يساهم هذا الأسلوب في تقويض مصداقية الضحايا، والتشكيك في دوافعهم.

3. تبديل الأدوار

في بعض الحالات، يُظهر التزييف المهاجم كضحية، ويُصوّر الضحية كمنفذ للاعتداء. يغيّر هذا التلاعب فهم الجمهور ويشوّه الرواية الحقيقية.

4. بث الشك الجماعي

حتى دون استخدام مباشر للتقنية، يشير الجاني إلى احتمال التزييف لإضعاف أي رواية تُدين سلوكه. هذا الشك يصبح أداة بحد ذاته.

أمثلة من الواقع

أثناء أحد النزاعات، نشر فريق إعلامي تابع لجهة مسلحة مقطعًا يُظهر حيًا سكنيًا يبدو سليمًا. ولكن صور الأقمار الصناعية أثبتت أن الموقع تعرّض لقصف قبل ساعات من نشر المقطع.

في مثال آخر، تداولت وسائل التواصل فيديو لامرأة تعترف بأنها “اختلقت” شهادتها حول التعذيب. لاحقًا، اكتشف فريق حقوقي تطابقًا تقنيًا بين الفيديو المزيف وشهادات أصلية، وأكد تحليل الصوت أنه تركيب متقن.

لماذا يشكّل هذا النوع من التضليل خطرًا مضاعفًا؟

- تعتمد مناطق النزاع غالبًا على التوثيق الميداني في ظل غياب مؤسسات مستقلة.

- تملك الجهات المتورطة الموارد التقنية لنشر محتوى مزيف بكفاءة عالية.

- لا يستطيع الضحايا أو المراسلون المحليون دائمًا إثبات صحة ما نشروا.

- يؤدي الشك المستمر إلى تآكل الثقة العامة بالمحتوى المرئي والصوتي، حتى لو كان حقيقيًا.

كيف نكشف التزييف العميق ونواجهه؟

أدوات تقنية

- Sensity AI وMicrosoft Video Authenticator: تكشف هذه الأدوات التلاعب في تعابير الوجه والتزامن بين الصوت والصورة.

- ExifTool: تحلّل البيانات الوصفية للصور والفيديوهات، وتساعد في التحقق من تاريخ ومكان الإنتاج.

- Amber Video: تمنح كل فيديو بصمة رقمية تساعد في التحقق من أصالته لاحقًا.

ممارسات ميدانية

- التوثيق من زوايا متعددة باستخدام أجهزة مختلفة يعزز المصداقية.

- أرشفة النسخ الأصلية دون ضغط أو تعديل يسهّل عملية التحقق.

- توفير معلومات مصاحبة للتسجيل، مثل توقيت التصوير وموقعه والسياق، يدعم مصداقية المحتوى.

وعي إعلامي وجماهيري

- يحتاج الجمهور إلى فهم أساسيات التزييف العميق ليتعامل بوعي مع المحتوى المشكوك فيه.

- توعية الصحفيين والحقوقيين بكيفية اكتشاف التزييف يجب أن تصبح جزءًا من التدريب الأساسي في البيئات عالية الخطورة.

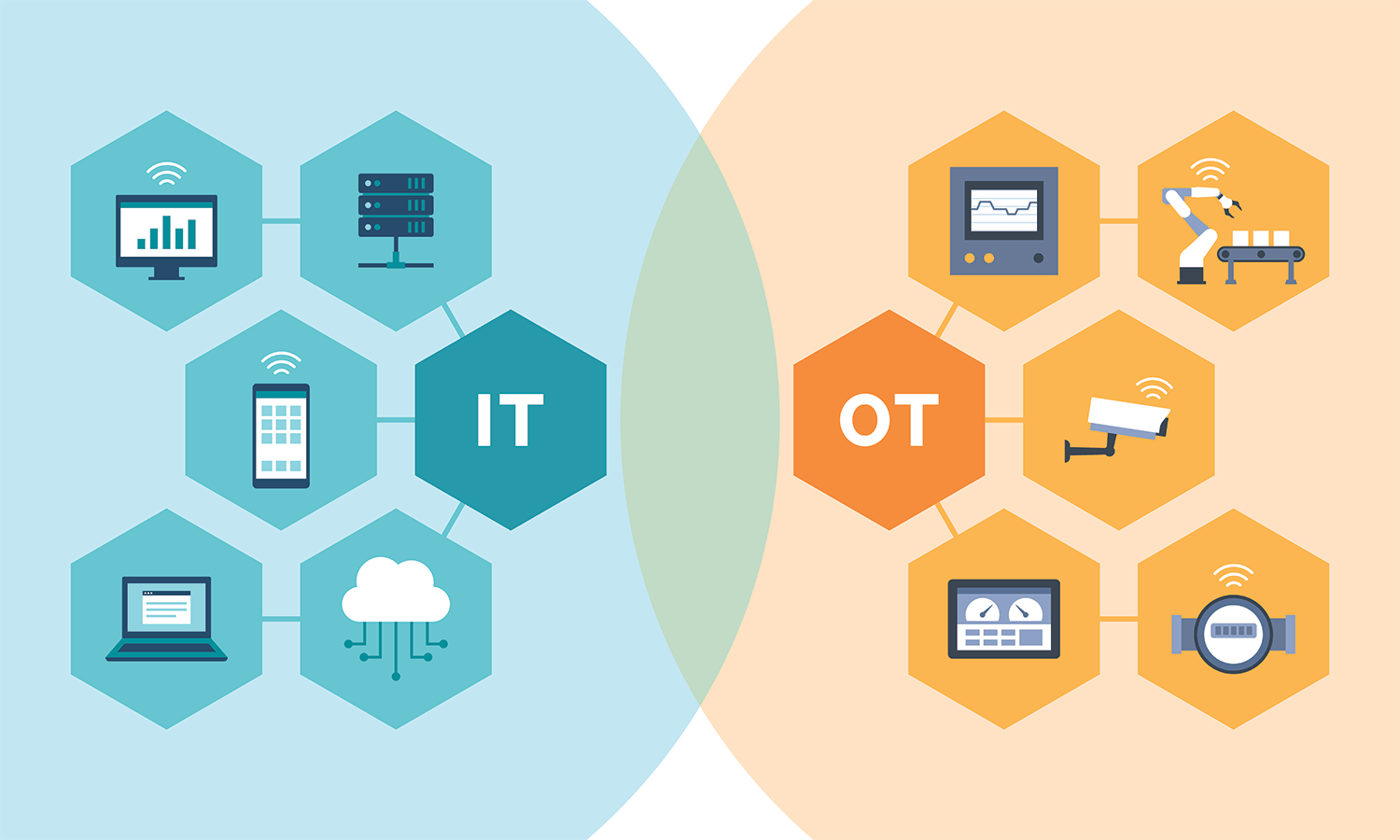

دور الإعلام والمنظمات الحقوقية

لا يكفي نشر الأدلة. يجب توثيقها بشكل احترافي، وتحليلها، وإرفاقها بسياق واضح. كما ينبغي تعزيز التعاون بين المؤسسات الإعلامية والخبراء التقنيين لمواجهة هذا النوع من التضليل.

على المنظمات الحقوقية أيضًا تطوير أدوات تحقق داخلية، ومشاركة تقارير تقنية عند نشر أي دليل مرئي في قضايا حساسة.

يشكّل التزييف العميق تهديدًا مباشرًا للحقيقة في زمن النزاعات. لكنه ليس تهديدًا لا يمكن مواجهته. عبر أدوات دقيقة، ووعي تقني، وممارسات تحقق صلبة، نستطيع حماية الأدلة والدفاع عن الحقيقة. في وجه التضليل المنهجي، لا يكفي أن نملك الصورة، بل يجب أن نحميها أيضًا.