تفرض النزاعات المسلحة تحديات كبيرة على محققي العدالة الدولية، خاصة عند محاولة توثيق الانتهاكات الجسيمة. غالبًا ما تكون الأدلة الميدانية محدودة أو مهددة بالضياع. في المقابل، نشهد تدفقًا غير مسبوق للصور ومقاطع الفيديو من المواطنين، الصحفيين، والطائرات المسيّرة.

لكن حجم البيانات البصرية المتوفرة يجعل تحليلها يدويًا أمرًا مرهقًا. في هذا السياق، تظهر خوارزميات الذكاء الاصطناعي كأدوات فعالة. تساعد هذه التقنيات في فرز الأدلة وتحديد المحتوى الأكثر صلة، مما يدعم العدالة الدولية.

الذكاء الاصطناعي والعدالة الدولية: إمكانات واعدة

الذكاء الاصطناعي هو فرع من علوم الحاسوب. يتيح هذا المجال للأنظمة أداء مهام تتطلب عادة تفكيرًا بشريًا. يشمل ذلك التعرف على الصور، تحليل اللغة، واستنتاج الأنماط.

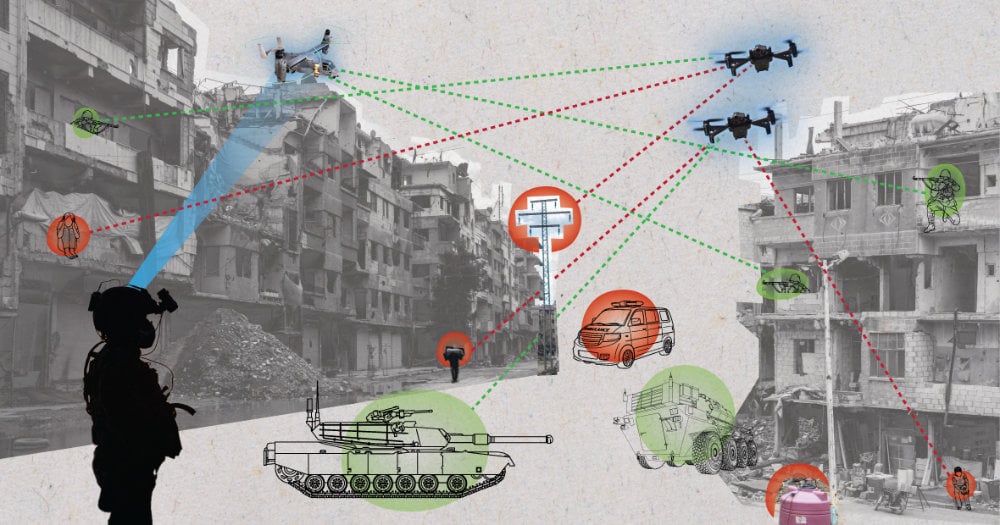

في مجال العدالة الدولية، يتم تدريب الأنظمة على تحليل مشاهد الانتهاكات مثل القصف أو تدمير البنية التحتية. تميز الخوارزميات عناصر مثل نوع السلاح، موقع الحادث، أو الجهة الفاعلة.

الميزة الأساسية تكمن في قدرة الذكاء الاصطناعي على تسريع الفحص وتقليل نسبة الخطأ. على سبيل المثال، يمكن لخوارزمية متطورة تحديد الموقع الجغرافي لضربة جوية خلال دقائق، وهو ما كان يستغرق ساعات عند الاعتماد على البشر فقط.

تحليل الفيديو: من الفوضى إلى الدليل

الهواتف الذكية أصبحت أدوات توثيق فعّالة. يصور شهود العيان انتهاكات كثيرة في ميادين الصراع. ولكن من دون تصنيف وتنظيم، يصعب استخدام هذه الفيديوهات كأدلة قانونية.

هنا يتدخل الذكاء الاصطناعي. تستخدم الأنظمة خوارزميات مثل الشبكات العصبية التلافيفية لتحليل كل إطار. تكتشف الكائنات داخل الفيديو: مركبات عسكرية، أسلحة، أو حتى شعارات فصائل مسلحة.

على سبيل المثال، استخدم مختبر حقوق الإنسان الرقمي التابع لمنظمة العفو الدولية خوارزميات ذكاء اصطناعي لتحليل مقاطع من سوريا. حدد النظام توقيت وموقع الضربات الجوية من خلال تقاطع الفيديوهات مع بيانات الأقمار الصناعية.

الأقمار الصناعية: رؤية واسعة من الأعلى

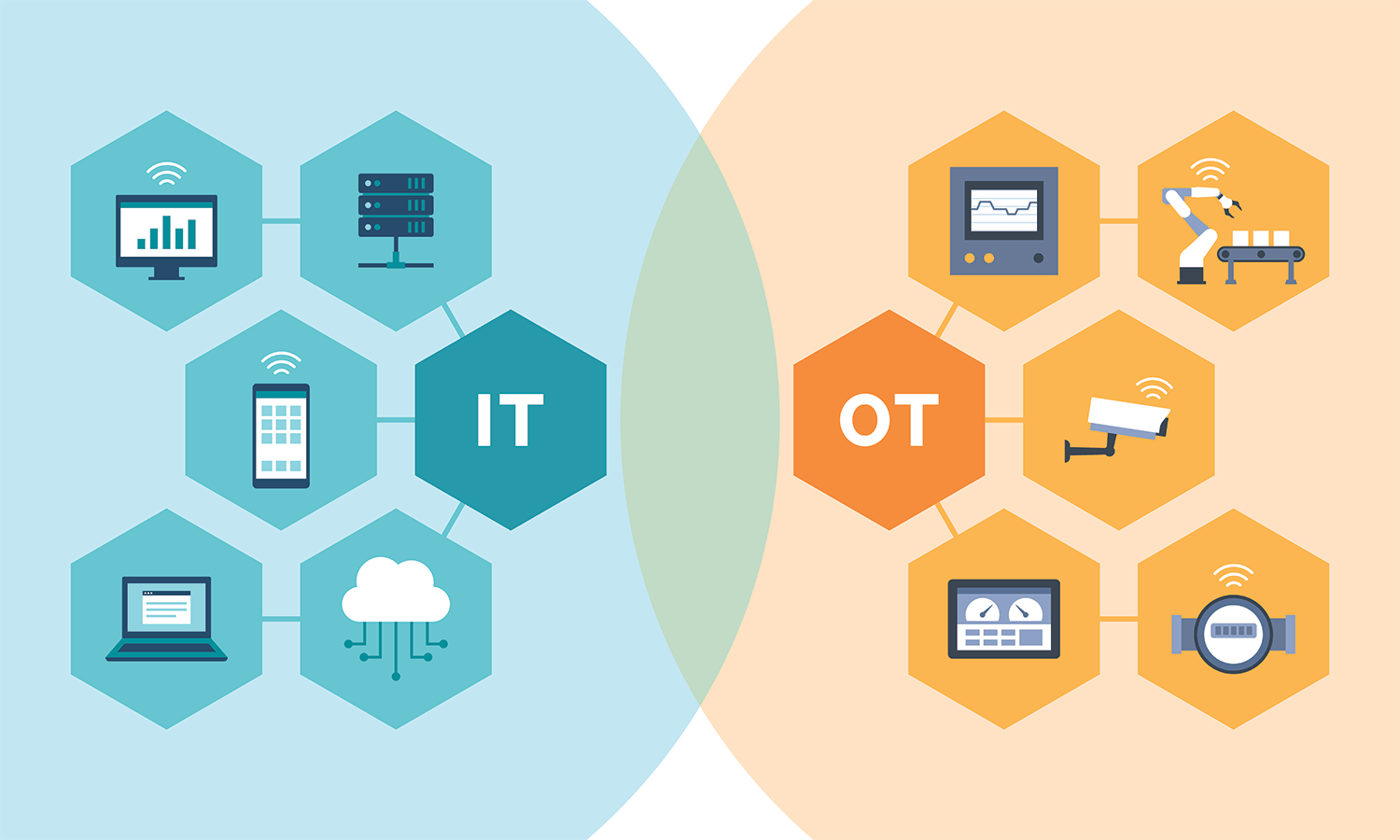

تُعد صور الأقمار الصناعية مصدرًا مهمًا لرصد الدمار وتحديد مسارات النزاعات. تقليديًا، كانت هذه الصور تُحلل يدويًا، مما استغرق وقتًا طويلاً.

الذكاء الاصطناعي غيّر هذه المعادلة. يمكن للخوارزميات اكتشاف تغيرات في البنية التحتية، أو تعرّف حرائق ودمار في المناطق المدنية. تعمل هذه الأدوات بسرعة ودقة تفوق العمل البشري.

في حالات مثل النزاع في أوكرانيا أو ميانمار، استخدمت منظمات مستقلة الذكاء الاصطناعي لمقارنة صور أقمار صناعية قبل وبعد الهجمات. ساعدت هذه التحليلات في توثيق الانتهاكات بدقة علمية قابلة للتقديم في المحاكم.

التحديات: بين التقنية والأخلاق

رغم الفوائد، تواجه هذه التقنيات تحديات مهمة. أولها هو الانحياز في البيانات. إذا كانت الصور المستخدمة في التدريب غير ممثلة لجميع البيئات، فإن النتائج قد تكون مضللة.

كذلك، يصعب تفسير بعض الخوارزميات. تعمل كـ”صناديق سوداء”، ما يثير القلق بشأن الشفافية. هذا يمثل مشكلة في السياقات القانونية التي تتطلب تفسيرًا واضحًا للنتائج.

جانب آخر يتطلب الانتباه هو معيار قبول الأدلة في المحاكم. يجب أن تخضع كل الأدلة الناتجة عن الذكاء الاصطناعي لمراجعة صارمة، للتأكد من أنها تستوفي المعايير القانونية والدولية.

دور الإنسان: إشراف لا غنى عنه

رغم التقدم في الذكاء الاصطناعي، ما زال الدور البشري محوريًا. لا يمكن للخوارزميات استبدال المحققين أو القانونيين. بل يجب أن تعمل كأداة داعمة، تحت إشراف مباشر من الخبراء.

يوصي المختصون بوضع بروتوكولات واضحة عند استخدام الذكاء الاصطناعي في هذا المجال. تشمل هذه الإرشادات مراجعة النتائج، توثيق طريقة التحليل، وضمان حماية الخصوصية والحقوق.

يقدّم الذكاء الاصطناعي فرصًا كبيرة لتعزيز التحقيقات في جرائم الحرب. يمكنه تسريع جمع الأدلة وتحسين دقتها، لكنه ليس بديلاً عن المحقق البشري. لتحقيق العدالة الدولية الحقيقية، لا بد من استخدام هذه الأدوات بمسؤولية، وبموازاة تطوير معايير قانونية وأخلاقية تحكم استخدامها.