مع تزايد تعقيد التهديدات الأمنية التقنية، يبرز الذكاء الاصطناعي (AI) كأداة قوية في كشف هذه التهديدات وتحليلها. لكن، كما هو الحال مع أي تكنولوجيا جديدة، يظل السؤال حول مدى موثوقية الذكاء الاصطناعي في هذا المجال محورياً. سنتناول في هذا المقال كيف يمكن الاستفادة من الذكاء الاصطناعي، وكيفية الوثوق به، بالإضافة إلى المخاطر والتحديات التي قد تواجهها المؤسسات عند استخدامه في الأمن السيبراني.

كيف يمكن الاستفادة من الذكاء الاصطناعي في الكشف عن التهديدات الأمنية التقنية؟

- تحليل البيانات الكبيرة:

- رصد الأنماط غير الطبيعية: يستطيع الذكاء الاصطناعي تحليل كميات ضخمة من البيانات بسرعة وفعالية، مما يمكّن من التعرف على الأنماط غير الطبيعية والسلوكيات المشبوهة التي قد تشير إلى تهديدات أمنية.

- التعلم من البيانات السابقة: يتم تدريب نماذج الذكاء الاصطناعي على بيانات تاريخية لتحديد الأنماط الشائعة للهجمات والتهديدات، مما يعزز القدرة على التنبؤ بالتهديدات المستقبلية.

- استجابة سريعة وفعالة:

- الكشف المبكر: يمكن للذكاء الاصطناعي اكتشاف التهديدات في مراحلها المبكرة، مما يسمح باتخاذ إجراءات استباقية للتصدي للهجمات قبل أن تتسبب في ضرر كبير.

- الاستجابة التلقائية: توفر أنظمة الذكاء الاصطناعي القدرة على اتخاذ قرارات سريعة بشأن كيفية التعامل مع التهديدات بناءً على التحليل الفوري، مما يقلل من الوقت اللازم للتعامل مع الهجمات.

- تحليل تهديدات متعددة الأبعاد:

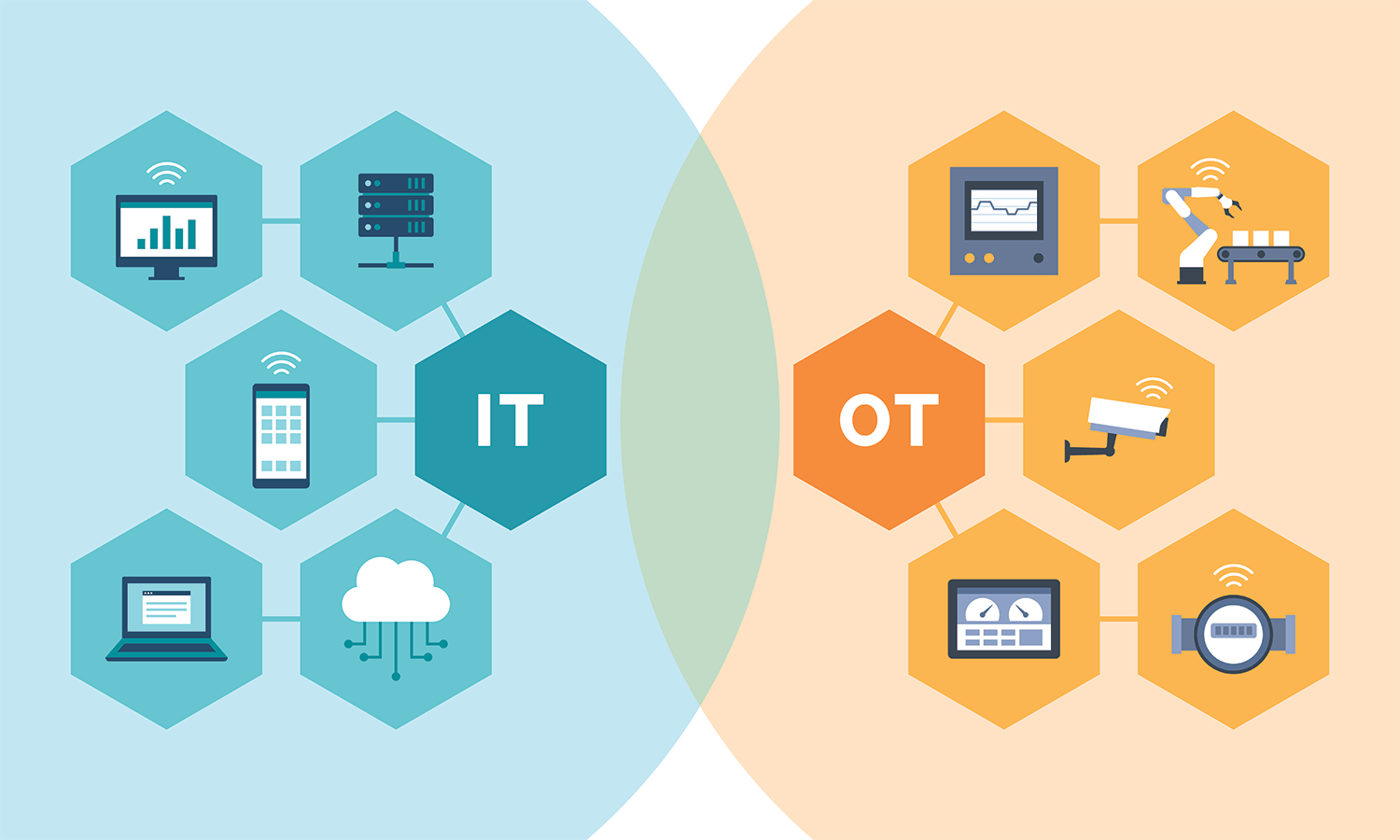

- التعرف على التهديدات متعددة الجوانب: يمكن للذكاء الاصطناعي معالجة المعلومات من مصادر متعددة (مثل الشبكات، والنظم، والتطبيقات) في وقت واحد، مما يوفر رؤية شاملة حول التهديدات الأمنية.

كيف يمكن الوثوق بالذكاء الاصطناعي في هذا المجال؟

- التحقق من دقة الأنظمة:

- اختبار الأنظمة بشكل منتظم: من الضروري إجراء اختبارات دورية على أنظمة الذكاء الاصطناعي لضمان دقتها وكفاءتها في الكشف عن التهديدات.

- تحديث نماذج الذكاء الاصطناعي: يجب تحديث نماذج الذكاء الاصطناعي بانتظام لتضمين أحدث المعلومات والتهديدات، وذلك لتحسين قدرتها على التعرف على الهجمات الجديدة.

- الشفافية والتفسير:

- الشفافية في القرارات: من المهم أن تكون الأنظمة قادرة على تقديم تفسيرات واضحة لقراراتها وتحليلاتها، مما يعزز الثقة في النتائج ويتيح للمسؤولين فهم كيفية وصول النظام إلى استنتاجاته.

- التكامل مع الخبرة البشرية:

- الرقابة البشرية: ينبغي أن يعمل الذكاء الاصطناعي كأداة مساعدة وليس بديلاً عن الخبراء البشر. يجب أن يكون هناك دائمًا عنصر بشري مسؤول عن مراجعة وتقييم نتائج الأنظمة الذكية واتخاذ القرارات النهائية.

المخاطر والتحديات المرتبطة بالذكاء الاصطناعي في الأمن السيبراني

- التحيز في البيانات:

- التحيز والتحقق: يمكن أن تؤدي البيانات المستخدمة لتدريب نماذج الذكاء الاصطناعي إلى تحيز في النتائج. يجب ضمان استخدام بيانات متنوعة وشاملة لتقليل هذه المخاطر.

- الأمن والخصوصية:

- التهديدات ضد الذكاء الاصطناعي: يمكن أن تكون أنظمة الذكاء الاصطناعي نفسها عرضة للهجمات. من الضروري حماية الأنظمة الذكية وتحديثها بانتظام لحمايتها من الاستغلال والتلاعب.

- تحديات التكيف:

- التكيف مع التهديدات الجديدة: قد لا تكون الأنظمة الذكية قادرة على التكيف بسرعة مع التهديدات الجديدة والمبتكرة. يتطلب هذا تحديثاً مستمراً وتحسيناً مستداماً للنماذج المستخدمة.

- مشكلة الشفافية:

- صعوبة التفسير: قد تكون بعض الأنظمة المعقدة صعبة التفسير، مما يجعل من الصعب فهم كيفية وصول النظام إلى استنتاجاته. يتطلب الأمر تحسين قدرات التفسير والشفافية في الأنظمة.

- اعتماد مفرط على التكنولوجيا:

- التوازن بين التكنولوجيا والعنصر البشري: يمكن أن يؤدي الاعتماد المفرط على الذكاء الاصطناعي إلى إغفال البعد البشري في التعامل مع التهديدات. من الضروري الحفاظ على توازن بين التكنولوجيا والخبرة البشرية.

الذكاء الاصطناعي يمثل أداة قوية في مجال الأمن السيبراني، مع قدرته على تحسين دقة وسرعة الكشف عن التهديدات الأمنية التقنية. ومع ذلك، فإن الموثوقية في الاعتماد على هذه التكنولوجيا تتطلب توازناً دقيقاً بين استخدام الذكاء الاصطناعي والتفاعل البشري. من خلال تحديث الأنظمة بشكل دوري، وضمان الشفافية، والحفاظ على الرقابة البشرية، يمكن تحقيق أقصى استفادة من الذكاء الاصطناعي مع التخفيف من المخاطر والتحديات المصاحبة له.