شهدت السنوات الأخيرة تطورًا كبيرًا في قدرة الذكاء الاصطناعي على تنظيم وتصفية المحتوى الرقمي. لم تقتصر هذه التطورات على تخصيص الإعلانات أو تسهيل التصفح، بل تجاوزتها إلى التأثير في ما يُرى وما يُنسى.

بات بالإمكان حذف محتوى حساس، أو إخفاؤه تحت طبقات من البيانات، دون أن يلاحظ المستخدم العادي. وهنا، تبرز الأسئلة: من يتحكم بالحقيقة؟ وكيف تتلاشى الأحداث من السجل الرقمي؟ ولماذا يُستخدم الذكاء الاصطناعي لإعادة كتابة التاريخ؟

آليات الذكاء الاصطناعي في التحكم بالمحتوى

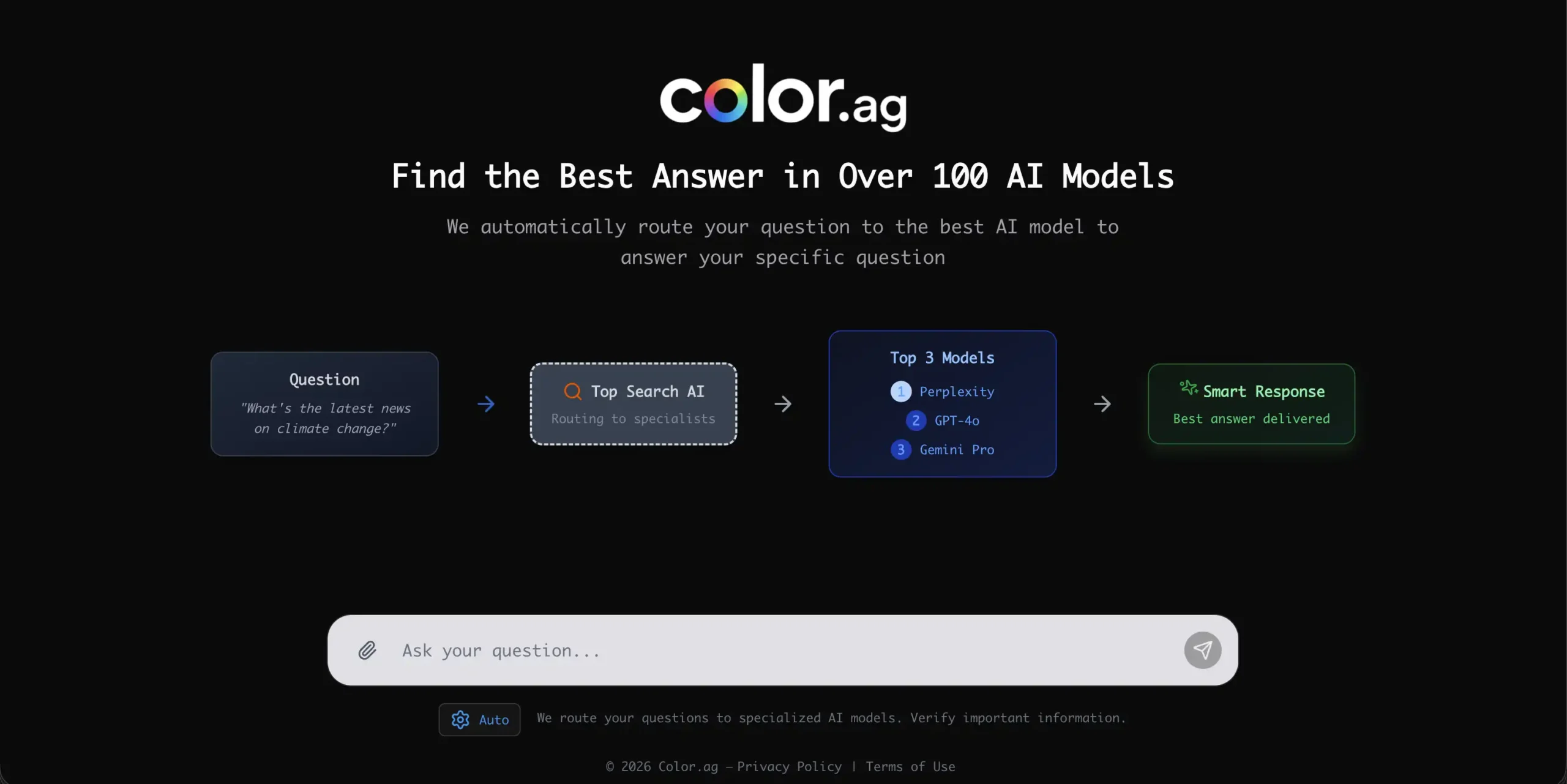

تعتمد منصات الإنترنت على خوارزميات معقدة لتحليل المعلومات وتصنيفها. تحدد هذه الخوارزميات ما يظهر في نتائج البحث، وما يُهمَّش أو يُخفى. عند توجيه الخوارزميات لتقليل ظهور محتوى معين، فإن المستخدم لن يراه، حتى لو بحث عنه مباشرة.

تركز هذه الأنظمة على التفاعل والانتشار أكثر مما تركز على القيمة التوثيقية للمحتوى. لذلك، يسهل على الجهات القوية التحكم بالرؤية العامة، ببساطة من خلال تعديل إعدادات الخوارزمية.

حذف الأدلة الرقمية: كيف يحدث ذلك؟

تعمل بعض الجهات على تدريب الذكاء الاصطناعي ليكتشف المحتوى الذي يُعتبر “مزعجًا” أو “غير ملائم”. بمجرد رصد هذا المحتوى، تبدأ عملية الحذف أو التعتيم.

تبدأ الخوارزميات بخفض التفاعل مع المادة، ثم تُزيلها من نتائج البحث، وأحيانًا تحذفها نهائيًا من السيرفرات. يحدث كل ذلك دون تنبيه المستخدم، أو عرض أسباب واضحة للحذف. وبذلك، تُمحى المادة من الوجود الرقمي دون أثر.

التزييف العميق: وسيلة لتشويه الحقيقة

إلى جانب الحذف، ظهرت أدوات أكثر خطورة تُعرف باسم “التزييف العميق” (Deepfake). تتيح هذه الأدوات إنتاج فيديوهات أو تسجيلات صوتية تُظهر أشخاصًا في مواقف لم يعيشوها.

عندما تُستخدم هذه التقنية لنفي شهادات حقيقية أو تزييف وثائق تاريخية، تصبح الحقيقة في خطر. لا يثق الناس بما يرونه، ولا يستطيعون تمييز الواقع من الخيال. ومع غياب مصادر محايدة، تنتصر الرواية الأقوى، لا الأصدق.

من يملك الحق في تعديل الذاكرة الرقمية؟

تُسيطر عدد محدود من الشركات الكبرى على منصات التواصل ومحركات البحث. تملك هذه الجهات القدرة الفنية والقانونية على إدارة المحتوى، وفقًا لسياساتها أو لضغوط خارجية.

في كثير من الأحيان، لا تخضع عمليات الحذف لأي رقابة مستقلة. لا تُتاح آليات مراجعة فعالة، ولا تتوفر شفافية في التعامل مع المحتوى. وبهذا، يُعاد تشكيل الذاكرة الرقمية عبر خوارزميات غير خاضعة للمساءلة.

التأثيرات المجتمعية

عندما تُمحى الأدلة، يتأثر التوثيق، وتضعف القدرة على المحاسبة.

يفقد الصحفيون مصادرهم، ويفقد الضحايا صوتهم، ويخسر الباحثون قاعدة بياناتهم. في النهاية، تنشأ ذاكرة عامة ناقصة، تعتمد على ما بقي لا على ما كان. ويُصبح من السهل إنكار الماضي، أو تزييفه، لأنه لم يَعُد قابلًا للإثبات.

ما الذي يُمكن فعله لحماية الحقيقة؟

لمواجهة هذا التحدي، لا بد من اتخاذ إجراءات تقنية وقانونية واجتماعية متكاملة:

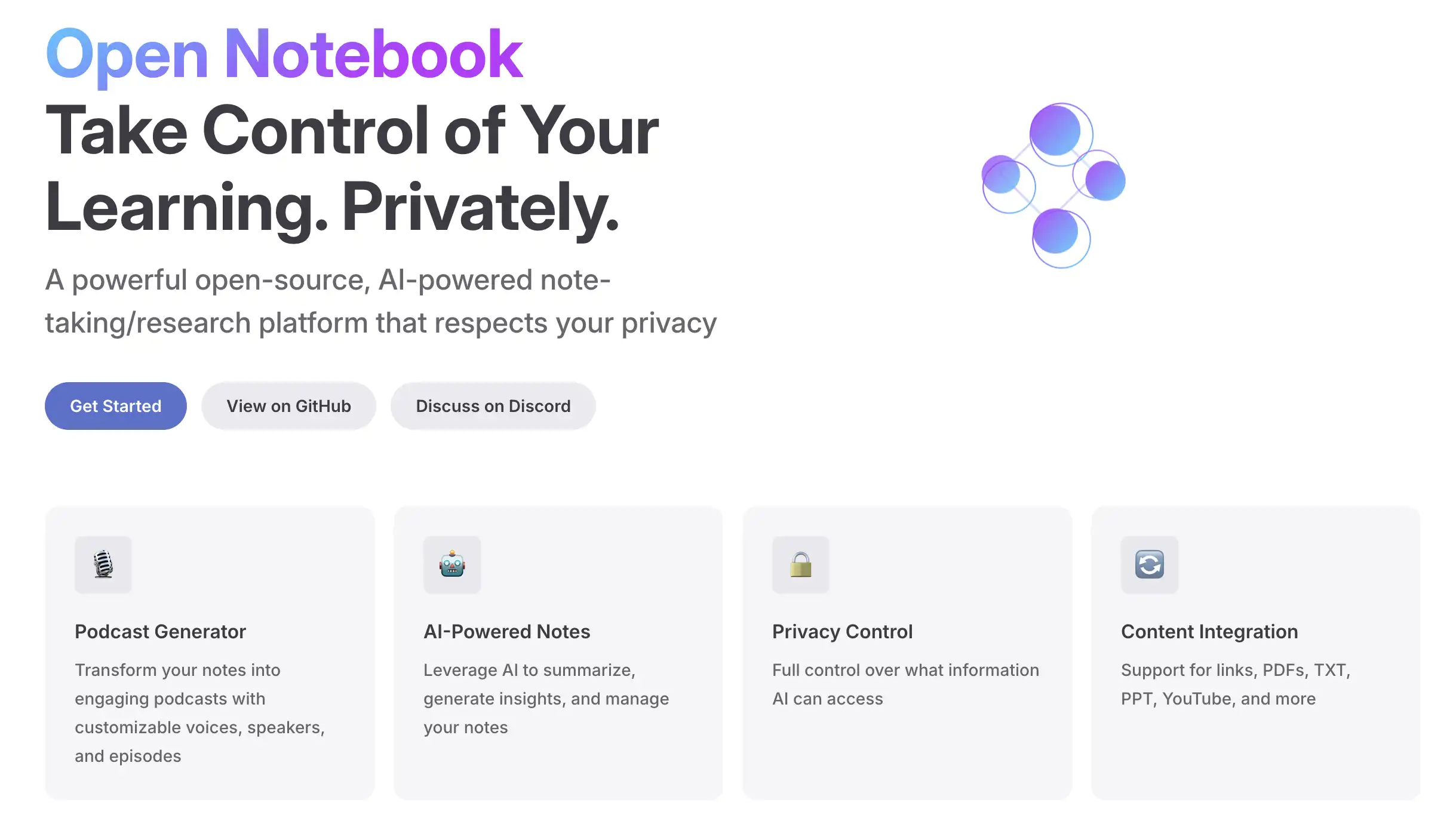

- تطوير أدوات أرشفة غير مركزية، تحصّن المحتوى من الحذف.

- تدريب النشطاء والصحفيين على التقنيات الآمنة لحفظ الأدلة.

- الضغط على الشركات لتوضيح معايير الحذف وتقديم سجل شفاف للقرارات.

- إصدار قوانين تُجرّم التلاعب المتعمد بالمحتوى الرقمي المرتبط بالصالح العام.

- تعزيز ثقافة التحقق الرقمي لدى الأفراد، لتقليل تأثير التضليل والتزييف.

الذكاء الاصطناعي كأداة للحماية أيضًا

رغم هذه التهديدات، يُمكن توجيه الذكاء الاصطناعي نحو دعم الحقيقة. تعمل بعض المبادرات على تطوير خوارزميات تتعرّف على محاولات التلاعب، وتُبلغ عنها، وتُوثّق التغييرات في الوقت الحقيقي.

كما يستطيع الذكاء الاصطناعي تتبع نسخ المحتوى ومقارنتها، واكتشاف التغييرات الدقيقة بين الإصدارات. يُمكن استخدام هذه القدرات لحماية الشهادات، وتوثيق أي تعديل غير مبرر.

لا يكمن الخطر الحقيقي في الذكاء الاصطناعي، بل في الطريقة التي يُستخدم بها.

عندما تتحول الخوارزميات إلى أدوات لخدمة السلطة أو السوق، وتُستخدم لحذف الأدلة أو تشويه الأحداث، يفقد الناس حقهم في الحقيقة. لذلك، يجب أن تبقى الرقابة في يد المجتمع، لا في يد من يكتب الكود.

حماية الذاكرة الرقمية مسؤولية مشتركة. ولكي نضمن عدم ضياع الحقيقة وسط الضجيج الاصطناعي، نحتاج إلى وعي، وتشريع، وتقنيات تُعيد للتاريخ صوته الأصلي.