أدى التحول نحو التعليم الرقمي إلى اعتماد واسع على أنظمة الامتحانات المؤتمتة التي تتيح تقييم آلاف الطلبة عن بُعد. غير أن هذا التحول، الذي فُرض جزئياً بفعل الجائحة، جلب معه أسئلة جديدة حول المراقبة، الثقة، والخصوصية. فبينما تسعى الجامعات إلى الحفاظ على النزاهة الأكاديمية، يشعر الطلاب بأنهم يخضعون لمستوى غير مسبوق من التتبع الرقمي.

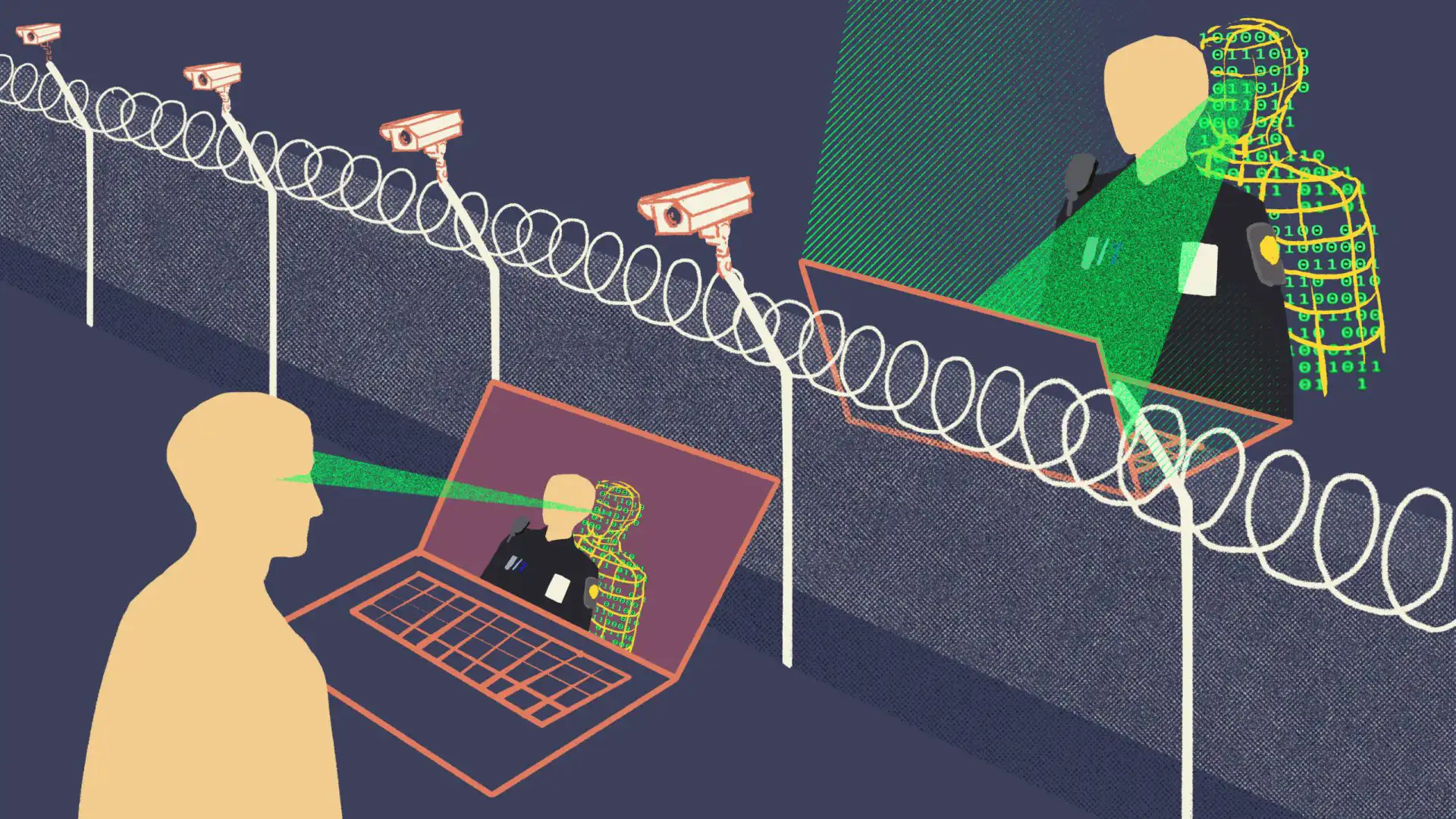

تستخدم هذه الأنظمة مزيجاً من الذكاء الاصطناعي والتعرف على الوجوه وتحليل الأنماط السلوكية لضمان منع الغش، لكنها في المقابل تجمع كميات ضخمة من البيانات الشخصية، من الصوت والصورة إلى حركات العين وسلوك لوحة المفاتيح. هذا المشهد يضع المؤسسات التعليمية أمام معادلة دقيقة: كيف نضمن العدالة دون انتهاك الخصوصية؟

البنية التقنية لأنظمة المراقبة المؤتمتة

تعتمد أنظمة المراقبة الرقمية أثناء الامتحانات على مكونات تقنية مترابطة تشمل الكاميرا، الميكروفون، وخوارزميات تحليل السلوك في الزمن الحقيقي.

أهم خصائصها التقنية:

- التعرف على الهوية: عبر تقنية التعرف على الوجه أو البصمة الصوتية للتحقق من أن الممتحن هو الشخص المسجل فعلاً.

- تحليل الأنشطة السلوكية: باستخدام الذكاء الاصطناعي لتتبع نظرات العين، حركات الرأس، أو الأصوات في الخلفية التي قد تشير إلى محاولة غش.

- التسجيل المستمر: تخزين الفيديو والصوت وبيانات الجهاز أثناء الاختبار لأغراض المراجعة اللاحقة.

- تحليل الجهاز والشبكة: فحص التطبيقات المفتوحة أو الأنشطة غير المصرح بها في الجهاز أثناء الامتحان.

هذه التقنيات تُدار غالباً عبر خوادم سحابية تتبع لمزودي خدمات خارجيين، ما يزيد من احتمالية تسرب البيانات أو إساءة استخدامها.

النزاهة الأكاديمية في البيئة الرقمية

يُعد الحفاظ على النزاهة أحد المبررات الأساسية لاعتماد أنظمة المراقبة المؤتمتة. فالتعليم عن بُعد فتح الباب أمام أساليب جديدة للغش يصعب اكتشافها بالوسائل التقليدية.

تُستخدم الخوارزميات للكشف عن الأنماط غير الطبيعية في سلوك الممتحن، مثل النظر المتكرر خارج الشاشة أو التوقف الطويل قبل الإجابة. كما تُقارن أنماط الكتابة وسرعة الطباعة مع بيانات سابقة للتأكد من هوية الكاتب.

ورغم فعالية هذه الأنظمة في بعض الحالات، إلا أنها ليست خالية من الأخطاء. إذ يمكن أن تفسر حركات عادية على أنها “محاولات غش”، أو أن تُعاقب الطلبة ذوي الإعاقات الجسدية الذين تختلف أنماط تفاعلهم مع الكاميرا أو لوحة المفاتيح.

الخصوصية بين الضرورة والاختراق

من أبرز الانتقادات الموجهة لأنظمة المراقبة المؤتمتة أنها تحول غرف الطلاب إلى فضاءات مراقبة دائمة. فالكاميرات تلتقط مشاهد من الحياة الخاصة، والميكروفونات تسجل محادثات عائلية، بينما تُخزن البيانات في خوادم خارجية قد تُستخدم لأغراض تحليلية أو تجارية.

كما أن بعض الأنظمة تطلب صلاحيات واسعة للوصول إلى محتوى الجهاز، مما يثير مخاوف أمنية جدية تتعلق بإمكانية استغلال هذه الصلاحيات. هذه الممارسات تضع المؤسسات التعليمية أمام مسؤولية قانونية في حال تسرب البيانات أو استخدامها خارج نطاق التقييم الأكاديمي.

البعد القانوني والتنظيمي

القوانين الدولية لحماية البيانات، مثل اللائحة العامة لحماية البيانات الأوروبية (GDPR)، تفرض معايير صارمة لمعالجة المعلومات الشخصية، خاصة تلك المتعلقة بالتعرف على الوجه أو الصوت. ومع ذلك، لا تزال العديد من المؤسسات التعليمية تتعامل مع البيانات بطرق تتعارض مع مبدأ “الحد الأدنى من الجمع”.

الطلاب في معظم الأنظمة التعليمية ليس لديهم خيار حقيقي بالرفض، إذ تُعتبر الموافقة على المراقبة شرطاً للمشاركة في الامتحان. هذه “الموافقة القسرية” تقوّض مبدأ الإرادة الحرة وتجعل الخصوصية الرقمية ثمنًا للنجاح الأكاديمي.

المخاطر التقنية والأمنية

تخزين بيانات الفيديو والصوت في أنظمة سحابية يعني وجود احتمالية دائمة للاختراق.

حوادث تسرب بيانات من مزودي خدمات المراقبة خلال الأعوام الأخيرة أثبتت هشاشة البنية الأمنية. فمجرد وصول طرف ثالث إلى هذه البيانات يمكن أن يؤدي إلى كشف هويات آلاف الطلاب أو التلاعب بنتائجهم.

إضافة إلى ذلك، قد تُستخدم خوارزميات المراقبة في التدريب على أنظمة ذكاء اصطناعي أخرى دون علم المستخدمين، مما يحول بياناتهم التعليمية إلى مواد تدريب تجارية لشركات خاصة.

التحدي الأخلاقي والإنساني

المراقبة الآلية تُعيد تعريف العلاقة بين الطالب والمؤسسة التعليمية. فبدلاً من الثقة والتقييم القائم على الكفاءة، يتحول النظام إلى جهاز رقابة دائم يشكك في صدق الجميع.

كما أن الاعتماد المفرط على الخوارزميات يُقصي البعد الإنساني للتعليم، إذ تُستبدل الملاحظة الأكاديمية بالتتبع الآلي الذي لا يميز بين السياق والخطأ.

التربية على النزاهة يجب أن تكون سلوكاً مكتسباً لا نتيجة خوف من المراقبة. فالاعتماد الكامل على التكنولوجيا دون تربية القيم الأكاديمية يخلق بيئة متوترة وغير منتجة علمياً.

مقترحات لتحقيق التوازن

لضمان التوازن بين النزاهة والخصوصية، يمكن للمؤسسات التعليمية تبني مجموعة من الإجراءات:

- تقليل جمع البيانات إلى الحد الأدنى اللازم للتحقق من الهوية.

- تشفير جميع الاتصالات والتسجيلات مع تحديد مدة زمنية قصيرة للاحتفاظ بالبيانات.

- تقديم بدائل للمراقبة المؤتمتة، مثل الامتحانات المفتوحة أو المشاريع البحثية.

- إشراك الطلاب في وضع سياسات المراقبة، لضمان الشفافية والمساءلة.

- إجراء مراجعات مستقلة لتقنيات المراقبة لضمان خلوها من الانحيازات التقنية أو التمييزية.

هذه الإجراءات تجعل العملية التعليمية أكثر إنصافاً وتقلل من الاعتماد المفرط على الأنظمة الخوارزمية المغلقة.

لابد من التذكّر

أن النزاهة الأكاديمية لا تتحقق فقط بالمراقبة، بل بالثقة والتثقيف والمسؤولية المشتركة. الخصوصية حق أصيل لا يجب التضحية به بحجة الرقابة التقنية. المطلوب هو بناء بيئة امتحانية عادلة تحمي قيم التعليم وتراعي كرامة المتعلم، بحيث يصبح الذكاء الاصطناعي أداة دعم لا أداة مراقبة. في النهاية، الحفاظ على الخصوصية هو أساس العدالة في أي نظام تعليمي رقمي مستدام.